La síntesis de voz ha sido durante años el eslabón débil de los sistemas de IA locales. Los modelos de texto generaban respuestas convincentes, los de imagen producían obras visualmente coherentes, pero en cuanto el sistema tenía que hablar, el resultado delataba su naturaleza artificial: entonación plana, ritmo mecánico, timbre genérico. Qwen3-TTS, lanzado por Alibaba en enero de 2026, propone algo diferente.

Lo hemos probado en profundidad. Lo que sigue son los resultados.

Qué es Qwen3-TTS

Modelo de síntesis de voz neuronal de dos tamaños (0,6B y 1,7B parámetros) con tres variantes funcionales: Base, CustomVoice y VoiceDesign. Soporta 10 idiomas incluyendo español. Nuestras pruebas se centraron en el modelo 1,7B.

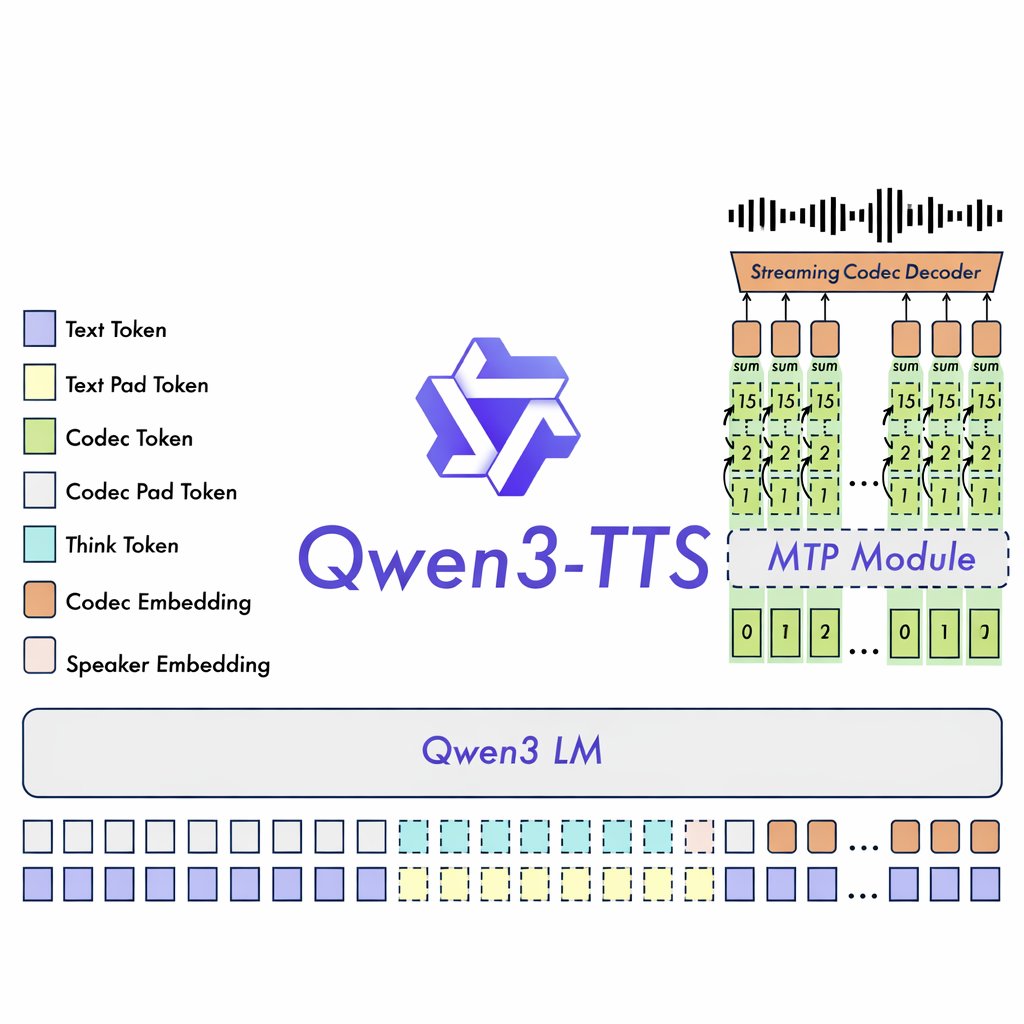

A diferencia de los sistemas TTS clásicos, que aprenden a reproducir fonemas a partir de reglas lingüísticas, Qwen3-TTS es un modelo de lenguaje entrenado sobre audio. Entiende el ritmo, la entonación y las pausas como parte del significado, no como un postprocesado añadido. Esto es lo que permite que el resultado suene a persona y no a máquina.

Las tres variantes

Voice cloning a partir de 3–15 segundos de audio de referencia. El acento y el timbre del audio se transfieren al output. La que más hemos utilizado.

9 voces predefinidas con control de emoción y tono. Listas para usar sin audio de referencia.

Crear una voz nueva desde una descripción textual: «voz masculina grave, tranquila, ligeramente ronca».

Punto de partida: las voces predefinidas

Antes de explorar la clonación, probamos las nueve voces de CustomVoice generando el mismo texto en español con cada una. El objetivo era encontrar cuál funcionaba mejor como base en castellano antes de pasar a voces propias.

Las voces predefinidas están entrenadas principalmente sobre inglés y chino. En español suenan con acento extranjero —perceptible pero no distorsionador— y la entonación tiene un patrón ligeramente ajeno al castellano peninsular. De las nueve, Uncle_Fu resultó la más neutra en español: entonación más plana, menos marcas prosódicas del inglés.

Este es el límite esperado de las voces preset. La solución real para castellano con acento nativo es la clonación.

¿Cómo funciona la clonación de voz?

El modelo recibe un audio de referencia de 3 a 15 segundos —la voz real de una persona— junto con su transcripción. Extrae de ese audio las características vocales: timbre, frecuencia fundamental, ritmo habitual, resonancia. Esas características se convierten en un vector que el modelo usa como condición durante la generación.

El resultado es un audio nuevo, con el texto que se quiera, que suena con la voz de la persona del audio de referencia. No es una grabación: es síntesis. El modelo nunca «almacena» la voz — la reconstruye cada vez a partir del vector extraído.

El acento del audio de referencia se transfiere. Si la persona de referencia habla en castellano peninsular, el output también lo hará.

Voice cloning en castellano: los resultados

Para las pruebas de clonación grabamos audios de referencia en castellano peninsular de entre 3,7 y 11 segundos. La transcripción automática se realizó con Whisper. El texto de prueba fue una presentación de un asistente virtual de 168 caracteres.

| Voz clonada | Ref. audio | Generación | Duración output | VRAM pico |

|---|---|---|---|---|

| julieta (femenina) | — | 5,8s | 7,5s | 5.884 MB |

| embajador (masc.) | 11s ref. | 5,2s | 7,9s | 6.225 MB |

| xavi (masc.) | 4s ref. | 5,1s | 7,8s | 6.225 MB |

| embajador001 (masc.) | 3,7s ref. | 5,9s | 9,0s | 6.225 MB |

El ratio de 1,43× realtime significa que el modelo genera el audio más rápido de lo que dura. Para 7,5 segundos de audio se necesitan 5,2 segundos de cómputo. Es suficiente para aplicaciones conversacionales con un pequeño buffer de previsión.

En timbre y personalidad vocal el resultado es sólido: la voz clonada suena a la persona de referencia, el acento castellano se transfiere y el resultado no es robótico. Incluso la referencia más corta —3,7 segundos— preservó las características vocales esenciales. Donde aparecen los matices es en la expresividad: el modelo tiene un rango emocional más estrecho que un actor. El timbre es el de la persona; la actuación es la del modelo.

Un dato técnico importante: cada llamada de generación necesita el audio de referencia. No existe un sistema nativo de «guardar voz». Sin embargo, el procesamiento del audio de referencia es prácticamente instantáneo (menos de 0,5 segundos), por lo que no representa un cuello de botella en producción.

¿Puede el modelo actuar?

Para creadores que trabajan en animación, doblaje o agentes con personalidad, la pregunta clave no es si el modelo clona bien una voz —eso ya lo sabíamos— sino si puede actuar: cambios de ritmo, intensidad emocional, pausa dramática, gritos creíbles. Preparamos una escena diseñada para forzar exactamente eso.

El resultado es válido para animación y producción de contenido, con expectativas ajustadas. Los cambios de registro son perceptibles: el salto de la voz deprimida a los gritos existe y se escucha. Pero la distancia entre el mínimo y el máximo es más corta que la de un actor profesional. El modelo responde a señales textuales —mayúsculas, signos de exclamación, puntos suspensivos— como instrucciones implícitas de intensidad, pero no con la libertad expresiva de un intérprete humano.

¿Qué significa esto para producción? Para un corto de animación con personajes estilizados, donde el rango expresivo es amplio y el espectador acepta cierta convención, el resultado es directo. Para un audiolibro dramático o un doblaje de ficción realista que necesite matiz psicológico fino, hay que trabajar fragmento a fragmento: generar cada estado emocional por separado, iterar el texto hasta afinar la interpretación, luego montar. Es un flujo de trabajo posible y controlado, no una limitación que bloquee la producción —simplemente no es magia de una pasada.

Diálogo entre dos personajes

El modelo no genera múltiples voces en una sola llamada. Cada generación produce una voz. Pero los fragmentos pueden concatenarse con código estándar de audio en Python, lo que permite construir escenas de diálogo completas con voces diferentes.

Probamos esto con una escena de dibujos animados: una princesa histérica encuentra a un dragón torpe en su castillo que solo buscaba el baño.

El resultado técnico es inmediato: seis llamadas al modelo, seis WAVs generados en ~21 segundos, concatenados con NumPy en menos de un segundo. El audio final es un diálogo continuo con dos voces claramente distintas, en castellano, con timbre reconocible en cada personaje.

Lo que funciona y lo que no

- Clonación de voz en castellano

- Timbre y personalidad vocal

- Acento nativo desde referencia

- Referencia desde 3,7s de audio

- Diálogos multi-voz por concatenación

- Cambios de registro básicos

- 6,2 GB VRAM — hardware accesible

- Más rápido que el audio que genera

- Control expresivo fino: moderado

- No hay caché de voz guardada

- TTS no funciona en cuantización 4-bit

- Voces preset suenan con acento extranjero en español

- Flash-attention: probado, resultado 30% más lento en este tamaño de modelo

- Multilocutor nativo: no disponible

El dato de flash-attention merece una aclaración porque va contra la intuición. Flash-attention acelera la atención en modelos grandes con contextos largos, donde los cálculos de atención son el cuello de botella. En Qwen3-TTS 1.7B el cuello de botella está en otra parte del pipeline —la síntesis de audio en sí— y añadir flash-attention introduce overhead sin compensación. En nuestras pruebas fue un 30% más lento que sin él. Es un recordatorio útil: las optimizaciones no son universales y la única manera de saberlo es medir.

La limitación del TTS en cuantización merece una nota: si se intenta cargar el modelo con BitsAndBytes 4-bit para reducir el uso de VRAM, el componente generador de voz no carga correctamente. El modelo requiere precisión completa (bf16). En la práctica, con 6,2 GB de pico durante la inferencia, cabe sin problema en tarjetas de 8 GB o más.

Conclusión

La voz local ya no suena a máquina

Qwen3-TTS 1.7B resuelve el problema que más limitaba la producción de voz con IA en castellano: el acento. Con cuatro segundos de referencia de una voz española, el modelo genera audio con ese timbre y ese acento. No es una aproximación — es la voz de esa persona diciendo cualquier texto que se le pida, generado en local, sin APIs, sin coste por petición.

Para animación, el flujo es inmediato: graba una voz de referencia para cada personaje, genera los diálogos fragmento a fragmento, monta. El timbre diferencia a los personajes con claridad. La expresividad cubre el rango de la animación estilizada sin problema; para drama psicológico realista hay que iterar más.

Para agentes conversacionales, el caso de uso es todavía más directo: una voz corporativa clonada del portavoz real de la empresa, generando respuestas en tiempo casi real (1,43× realtime), con 6,2 GB de VRAM. Un agente de voz completo —LLM + TTS— cabe en una tarjeta gráfica de gama alta y funciona sin conexión.

Lo que el modelo no hace todavía: actuar con paleta emocional completa en una sola pasada. Eso requiere trabajo de dirección —igual que con un actor, pero desde el teclado. La diferencia es que el actor nunca se cansa, nunca pide cachets y genera la toma en cinco segundos.

Comentarios (0)

No hay comentarios todavía.

Dejar un Comentario